Prijateljska veštačka inteligencija

Prijateljska veštačka inteligencija (takođe prijateljska VI ili FAI) je hipotetička veštačka opšta inteligencija (AGI) koja bi imala pozitivan (benigni) efekat na čovečanstvo ili bi se barem uskladila sa ljudskim interesima ili doprinela unapređenju ljudske vrste. Ona je deo etike veštačke inteligencije i usko je povezana sa mašinskom etikom. Dok se mašinska etika bavi time kako bi se veštački inteligentni agent trebao ponašati, istraživanje prijateljske veštačke inteligencije je fokusirano na to kako da se ovo ponašanje praktično ostvari i da se obezbedi da je adekvatno ograničeno.

Etimologija i upotreba

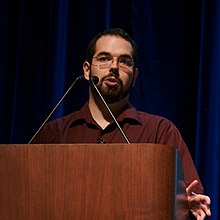

Termin je skovao Eliezer Judkovski,[1] koji je najpoznatiji po popularizaciji ideje,[2][3] zarad diskusije o superinteligentnim veštačkim agensima koji pouzdano primenjuju ljudske vrednosti. Vodeći udžbenik veštačke inteligencije Stjuarta J. Rasela i Pitera Norviga, Veštačka inteligencija: savremeni pristup, opisuje ideju:[2]

Judkovski (2008) detaljnije govori o tome kako dizajnirati prijateljsku VI. On tvrdi da ljubaznost (želja da se ne naudi ljudima) treba da se osmisli od samog početka, ali da dizajneri treba da prepoznaju i da njihovi sopstveni dizajni mogu biti manjkavi, i da će robot učiti i evoluirati tokom vremena. Stoga je taj izazov činilac u dizajnu mehanizama – definisati mehanizam za razvoj VI sistema u okviru sistema provera i ravnoteže, i dati sistemima uslužne funkcije koje će ostati prijateljski suočene sa takvim promenama.

'Prijateljski' se u ovom kontekstu koristi kao tehnička terminologija, i odnosi se na agente koji su bezbedni i korisni, a ne nužno one koji su „prijateljski” u kolokvijalnom smislu. Ovaj koncept se prvenstveno poziva u kontekstu diskusija o rekurzivno samopoboljšavajućim veštačkim agensima koji brzo espandiraju u pogledu inteligencije, na osnovu toga da bi ova hipotetička tehnologija imala veliki, brz i teško kontrolisani uticaj na ljudsko društvo.[4]

Reference

- ^ Tegmark, Max (2014). „Life, Our Universe and Everything”. Our Mathematical Universe: My Quest for the Ultimate Nature of Reality (First изд.). Knopf Doubleday Publishing. ISBN 9780307744258. „Its owner may cede control to what Eliezer Yudkowsky terms a "Friendly AI,"...”

- ^ а б Russell, Stuart; Norvig, Peter (2009). Artificial Intelligence: A Modern Approach. Prentice Hall. ISBN 978-0-13-604259-4.

- ^ Leighton, Jonathan (2011). The Battle for Compassion: Ethics in an Apathetic Universe. Algora. ISBN 978-0-87586-870-7.

- ^ Wallach, Wendell; Allen, Colin (2009). Moral Machines: Teaching Robots Right from Wrong. Oxford University Press, Inc. ISBN 978-0-19-537404-9.

Literatura

- Yudkowsky, E. Artificial Intelligence as a Positive and Negative Factor in Global Risk. In Global Catastrophic Risks, Oxford University Press, 2008.

Discusses Artificial Intelligence from the perspective of Existential risk. In particular, Sections 1-4 give background to the definition of Friendly AI in Section 5. Section 6 gives two classes of mistakes (technical and philosophical) which would both lead to the accidental creation of non-Friendly AIs. Sections 7-13 discuss further related issues. - Omohundro, S. 2008 The Basic AI Drives Appeared in AGI-08 - Proceedings of the First Conference on Artificial General Intelligence

- Mason, C. 2008 Human-Level AI Requires Compassionate Intelligence Архивирано 2022-01-09 на сајту Wayback Machine Appears in AAAI 2008 Workshop on Meta-Reasoning:Thinking About Thinking

- Froding, B. and Peterson, M 2021 Friendly AI Ethics and Information Technology volume 23, pp. 207–214.

Spoljašnje veze

- Ethical Issues in Advanced Artificial Intelligence by Nick Bostrom

- What is Friendly AI? — A brief description of Friendly AI by the Machine Intelligence Research Institute.

- Creating Friendly AI 1.0: The Analysis and Design of Benevolent Goal Architectures — A near book-length description from the MIRI

- Critique of the MIRI Guidelines on Friendly AI — by Bill Hibbard

- Commentary on MIRI's Guidelines on Friendly AI — by Peter Voss.

- The Problem with ‘Friendly’ Artificial Intelligence — On the motives for and impossibility of FAI; by Adam Keiper and Ari N. Schulman.